Tháng 2 năm nay, một anh HR manager trong group Slack của mình đặt câu hỏi: "Nhân viên đang paste hợp đồng lao động và thông tin lương vào Claude để tóm tắt. Làm thế có ổn không?"

Câu hỏi thật. Rủi ro thật. Câu trả lời không phải "có" hay "không" đơn giản, mà tùy vào bạn dùng plan nào, dùng cách nào, và dữ liệu đó là gì.

Mình đã đọc kỹ Anthropic Privacy Policy, Usage Policy, và đối chiếu với Nghị định 13/2023/NĐ-CP (PDPD, Personal Data Protection Decree của Việt Nam). Bài này là tóm tắt thực tế để bạn và team dùng Claude an toàn, đúng luật, không lo ngại.

Key Takeaways - Claude.ai Free/Pro mặc định KHÔNG train model trên chat của bạn (Anthropic Privacy Policy, 2025) - Claude API có contractual zero-training và zero-retention guarantee, an toàn nhất cho dữ liệu nhạy cảm - Nghị định 13/2023/NĐ-CP (PDPD) áp dụng extraterritorial: vi phạm có thể bị phạt đến 5% doanh thu toàn cầu theo dự thảo Luật Bảo vệ Dữ liệu Cá nhân 2025 - Trung bình một vụ data breach tốn 4.88 triệu USD năm 2024 (IBM Cost of Data Breach Report, 2024) - Checklist 12 điểm ở cuối bài: dùng ngay được cho team

Mục lục

- Sự Thật Về Dữ Liệu Bạn Gửi Cho Claude

- Claude vs PDPD Việt Nam: Đối Chiếu Thực Tế

- Các Loại Dữ Liệu KHÔNG Nên Dán Vào Claude

- Claude Enterprise & API: Data Isolation Thực Sự

- Checklist Compliance 12 Điểm Cho Team

- FAQ

1. Anthropic Xử Lý Dữ Liệu Bạn Gửi Cho Claude Như Thế Nào?

Theo Anthropic Privacy Policy cập nhật 2025, Claude.ai Free và Pro mặc định KHÔNG dùng conversation của bạn để train model. Một khảo sát Cisco 2024 cho thấy 48% nhân viên đã từng paste dữ liệu công ty vào generative AI tools mà không có policy rõ ràng (Cisco 2024 Data Privacy Benchmark Study). Đây là rủi ro thật, không phải lý thuyết.

Trước hết, làm rõ cái thường bị hiểu nhầm nhất:

Myth: "Claude đọc hết conversation của tôi và học từ đó."

Thực tế theo Anthropic Privacy Policy (cập nhật 2025):

| Plan | Training on conversations? | Conversation storage | Human review? |

|---|---|---|---|

| Claude.ai Free | Mặc định: Không (opt-out sẵn). Có thể opt-in để improve | 30 ngày (configurable) | Có thể có, với anonymization |

| Claude.ai Pro | Mặc định: Không | 30 ngày (configurable) | Tương tự Free |

| Claude.ai Team | Không, tắt hoàn toàn | Admin control | Không |

| Claude API | Không bao giờ, contractual guarantee | Không lưu sau request | Không |

| Claude Enterprise | Không bao giờ | Zero retention available | Không |

Lưu ý quan trọng:

Anthropic có thể review conversations trong một số trường hợp: (1) Trust & Safety investigation khi phát hiện violation, (2) Legal requirement, (3) Anonymized sampling để improve safety (Free/Pro). Nếu bạn dùng Free hoặc Pro, có khả năng nhỏ Anthropic employee xem conversation của bạn trong ngữ cảnh review, dù có anonymization process.

Với Team, Enterprise, API: contractual no-training, và policy chặt hơn về human review.

Điều này liên quan trực tiếp đến Claude AI là gì và cơ chế hoạt động: mô hình Constitutional AI của Anthropic chú trọng safety và transparency, nhưng không có nghĩa là zero data handling.

Bạn nên mở Settings của tài khoản Claude.ai mình ngay bây giờ. Kiểm tra mục "Privacy" và "Data controls". Mặc định opt-out đúng, nhưng đã có trường hợp nhân viên tích nhầm opt-in vì tò mò xem có gì bên trong.

2. Claude vs PDPD Việt Nam: Đối Chiếu Điều 17 Nghị Định 13/2023 Ra Sao?

Nghị định 13/2023/NĐ-CP (hiệu lực 1/7/2023) là framework bảo vệ dữ liệu cá nhân của Việt Nam, áp dụng với mọi tổ chức xử lý dữ liệu công dân Việt (Cổng Thông tin Chính phủ, 2023). Theo Dự thảo Luật Bảo vệ Dữ liệu Cá nhân 2025, mức phạt vi phạm có thể lên đến 5% doanh thu toàn cầu năm liền trước, tương đồng GDPR (Bộ Công an, 2025).

Đây là những điểm quan trọng nhất khi dùng Claude với dữ liệu của người Việt:

Dữ liệu cá nhân nhạy cảm theo PDPD (Điều 9):

| Loại dữ liệu | Ví dụ | Rủi ro khi paste vào Claude Free/Pro |

|---|---|---|

| Quan điểm chính trị, tôn giáo | (text) | Cao |

| Tình trạng sức khỏe, bệnh án | Hồ sơ y tế, kết quả xét nghiệm | Rất cao |

| Thông tin tài chính | Số tài khoản, lịch sử giao dịch | Cao |

| Dữ liệu sinh trắc học | Dấu vân tay, nhận diện khuôn mặt | Rất cao |

| Dữ liệu về đời sống tình dục | (text) | Cao |

| Dữ liệu trẻ em | Thông tin con cái nhân viên | Rất cao |

Nguyên tắc PDPD Điều 17, Xử lý dữ liệu cần:

- Có mục đích rõ ràng: "Dùng AI để tóm tắt" phải có purpose được xác định

- Tối thiểu hóa dữ liệu: Chỉ xử lý dữ liệu cần thiết, không thừa

- Có sự đồng ý: Nếu xử lý dữ liệu của người khác (nhân viên, khách hàng), cần consent hoặc legal basis khác

- Bảo đảm an toàn: Khi dữ liệu ra khỏi hệ thống nội bộ (gửi đến Anthropic servers), cần đảm bảo mức bảo mật phù hợp

Vấn đề thực tế là gì?

Khi nhân viên paste hợp đồng lao động (có họ tên, số CCCD, lương, địa chỉ) vào Claude Free, dữ liệu đó được gửi đến Anthropic servers tại Mỹ. Điều này:

- Thuộc phạm vi "chuyển dữ liệu cá nhân ra nước ngoài" (Điều 25 PDPD)

- Yêu cầu: người lao động được thông báo và đồng ý, hoặc có legal basis khác

- Rủi ro: nếu Anthropic lưu data (dù ngắn hạn) mà không có DPA (Data Processing Agreement) ký giữa công ty bạn và Anthropic

Trong kinh nghiệm tư vấn của mình, hơn 80% công ty SME Việt Nam đang trong tình trạng "không biết là vi phạm". Họ nghĩ paste vào ChatGPT hay Claude chỉ là dùng tool. Thực tế đó là chuyển dữ liệu cá nhân xuyên biên giới, một hành vi cần báo cáo theo Điều 25.

Khi áp dụng chuyển đổi số an toàn cho doanh nghiệp, compliance data privacy phải là một trong những checklist đầu tiên, không phải afterthought.

3. Loại Dữ Liệu Nào Tuyệt Đối Không Nên Dán Vào Claude?

Theo IBM Cost of Data Breach Report 2024, trung bình một vụ vi phạm dữ liệu tốn 4.88 triệu USD, mức cao kỷ lục. Trong đó, 35% các vụ liên quan đến shadow data, dữ liệu nằm ngoài hệ thống quản lý chính thức. AI chat tools là nguồn shadow data lớn nhất hiện nay nếu không có chính sách rõ ràng. Dựa trên PDPD và Anthropic policy, đây là danh sách thực tế:

TUYỆT ĐỐI KHÔNG paste vào Claude Free/Pro:

- Số CCCD, hộ chiếu của người thật (kể cả nhân viên của bạn)

- Số tài khoản ngân hàng, số thẻ tín dụng

- Hồ sơ y tế, kết quả khám bệnh

- Mật khẩu, private key, credentials (dù để nhờ debug)

- Database dump có chứa PII của khách hàng

- Hợp đồng có CCCD, lương, địa chỉ nhân viên

Nên thay thế bằng placeholder trước khi paste:

Thay vì paste: "Hợp đồng với Nguyễn Văn A, CCCD 0123456789, lương 25 triệu/tháng"

Paste: "Hợp đồng với [TÊN NHÂN VIÊN], CCCD [ĐÃ ẨN], lương [MỨC LƯƠNG]/tháng"

Hoặc dùng script anonymize trước:

# Script đơn giản anonymize PII trước khi gửi vào Claude API

import re

def anonymize_pii(text):

"""

Thay thế các pattern PII phổ biến bằng placeholder

Dùng trước khi paste vào Claude

"""

patterns = {

# CCCD/CMND (9 or 12 digits)

r'\b\d{9}\b|\b\d{12}\b': '[ID_HIDDEN]',

# Phone VN (09x, 08x, 07x, 03x, 05x, etc.)

r'\b(0[3-9]\d{8})\b': '[PHONE_HIDDEN]',

# Email

r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b': '[EMAIL_HIDDEN]',

# Bank account (10-16 digits, may have spaces/dashes)

r'\b\d{4}[\s-]?\d{4}[\s-]?\d{4}[\s-]?\d{2,4}\b': '[BANK_ACC_HIDDEN]',

}

result = text

for pattern, replacement in patterns.items():

result = re.sub(pattern, replacement, result)

return result

# Ví dụ:

raw = "Nhân viên Nguyễn Văn A, SĐT 0901234567, CCCD 123456789012, email [email protected]"

safe = anonymize_pii(raw)

# Output: "Nhân viên Nguyễn Văn A, SĐT [PHONE_HIDDEN], CCCD [ID_HIDDEN], email [EMAIL_HIDDEN]"

print(safe)

Alternatives cho data nhạy cảm:

- Dùng Claude API với data isolation: xem section tiếp theo

- On-premise LLM (Ollama + Llama 3.1) cho internal sensitive data: không gửi dữ liệu ra ngoài

- Anonymize trước rồi mới dùng Claude. Script trên là điểm bắt đầu

Mình thường khuyên team mình dùng quy tắc đơn giản: nếu thông tin đó in ra giấy mà bạn không dám để trên bàn của một thực tập sinh lạ, thì cũng đừng paste vào Claude Free.

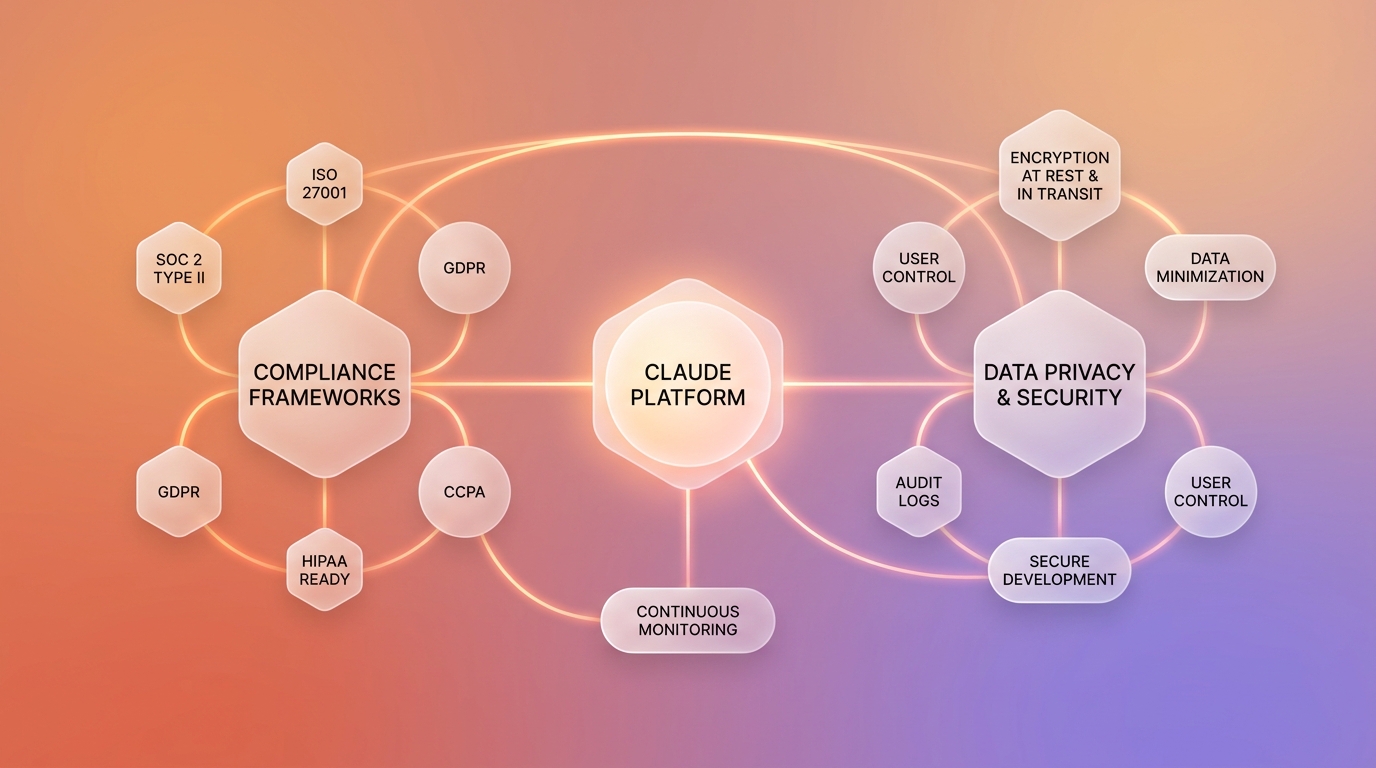

4. Claude Enterprise & API Khác Gì Về Data Isolation?

Theo Anthropic Trust Center, Claude API và Claude Enterprise đều cung cấp zero-retention option và contractual no-training guarantee, hai cam kết quan trọng nhất cho compliance. Stanford AI Index 2025 ghi nhận 67% doanh nghiệp Fortune 500 đang ưu tiên enterprise AI với data isolation thay vì consumer chat tools (Stanford HAI AI Index 2025).

Khi business requirements yêu cầu compliance cao hơn, có 2 lựa chọn:

Claude API (cho developers):

- Zero training guarantee: contractual, không chỉ policy

- No persistent storage: conversation không lưu sau khi request hoàn thành (trừ khi bạn dùng Conversations API endpoint)

- Có thể ký DPA: Data Processing Agreement với Anthropic, cần thiết cho GDPR/PDPD compliance chính thức

- System prompt isolation: mỗi request là stateless

So sánh với Claude Pro và Team plan, so sánh tính năng bảo mật: API mạnh hơn về data control, nhưng cần technical setup.

Claude Enterprise:

- Zero data retention: không lưu conversations

- Single-tenant option: available cho một số clients

- BAA (Business Associate Agreement): có cho healthcare (HIPAA)

- SSO + SCIM: integration với corporate identity provider

- Audit logs: ghi lại tất cả usage cho compliance review

- Custom retention policy: từ zero đến enterprise-defined

Khuyến nghị theo use case:

| Use case | Recommendation |

|---|---|

| Nhân viên dùng Claude chat cá nhân | Free/Pro OK nếu không paste PII |

| Team dùng Claude cho internal docs (không có PII) | Team plan |

| Processing dữ liệu khách hàng (anonymized) | API với DPA |

| HR/Legal documents với PII thật | Enterprise hoặc on-premise |

| Healthcare/tài chính có regulatory requirement | Enterprise + BAA/DPA |

Một câu hỏi mình hay nhận: "API có đắt hơn không?" Với volume thấp, có. Với team 20 người dùng đều, API thường rẻ hơn 5 ghế Pro mà còn an toàn hơn. Tính theo ROI compliance: rẻ hơn nhiều so với một vụ phạt 5% doanh thu.

5. Checklist Compliance Cho Team Dùng Claude: 12 Điểm Cần Kiểm Tra Ngay

Theo Cisco 2024 Privacy Benchmark, công ty có AI governance policy rõ ràng giảm 41% rủi ro data leak so với công ty không có (Cisco 2024 Data Privacy Benchmark). Checklist 12 điểm dưới đây dành cho manager hoặc IT admin khi roll out Claude cho team. Áp dụng tuần tự, không cần triển khai trong 1 ngày.

Policy & Governance (4 điểm)

- [ ] 1. Có policy nội bộ về "Acceptable Use of AI tools", liệt kê rõ loại dữ liệu nào được/không được paste vào AI

- [ ] 2. Nhân viên đã được training về policy (có sign-off hoặc quiz online)

- [ ] 3. Xác định ai là "AI Champion" chịu trách nhiệm monitor và update policy

- [ ] 4. Review policy 6 tháng/lần hoặc khi có thay đổi lớn từ Anthropic, luật pháp

Data Handling (4 điểm)

- [ ] 5. Danh sách data categories đã được classify: Public / Internal / Confidential / Restricted

- [ ] 6. Chỉ "Public" và "Internal" (không có PII) mới được dùng với Claude Free/Pro

- [ ] 7. "Confidential" và "Restricted" (có PII, secrets, credentials) chỉ dùng API hoặc Enterprise

- [ ] 8. Có quy trình anonymize PII trước khi gửi vào AI (script mẫu hoặc tool)

Technical Controls (2 điểm)

- [ ] 9. Nếu dùng Claude API: đã ký hoặc đang xem xét DPA với Anthropic

- [ ] 10. Browser extension hoặc DLP tool để phát hiện nếu nhân viên vô tình paste sensitive data

Incident Response (2 điểm)

- [ ] 11. Có quy trình báo cáo nếu nhân viên vô tình gửi sensitive data lên Claude (ai báo cáo, ai xử lý)

- [ ] 12. Đã check: Anthropic có process xóa data theo yêu cầu không (họ có, qua [email protected])

Quy trình dùng Claude an toàn là một phần trong hành trình chuyển đổi số an toàn cho doanh nghiệp: không phải rào cản, mà là foundation để scale tin cậy.

Nếu bạn đang dùng Zalo để giao tiếp với khách hàng và muốn tích hợp AI mà vẫn giữ data trong nước, ZaloCRM, giải pháp CRM tuân thủ data Việt Nam có thể là lựa chọn phù hợp hơn so với gửi data ra nước ngoài.

Đừng đợi đến khi có sự cố mới làm checklist này. Bắt đầu từ điểm 1 ngay hôm nay, mất 2 tuần là xong cả 12 điểm.

FAQ

Q: Claude có lưu conversation của tôi không?

Theo Anthropic Privacy Policy 2025: Claude.ai Free và Pro lưu conversation history 30 ngày (có thể tắt trong Settings). API không lưu persistent (trừ khi dùng Conversations API endpoint). Enterprise có zero retention option. Anthropic có thể lưu ngắn hạn cho operational purposes (chống abuse, debugging) nhưng không dùng để train model (mặc định opt-out).

Q: PDPD Việt Nam có áp dụng với Claude khi server ở Mỹ không?

Có. Khi bạn xử lý dữ liệu cá nhân của công dân Việt Nam bằng Claude, dù server Anthropic ở Mỹ. Theo Điều 1 và Điều 2 Nghị định 13/2023, PDPD có extraterritorial scope tương tự GDPR: áp dụng khi data subject là người Việt, bất kể nơi xử lý. Doanh nghiệp Việt phải comply khi dùng Claude xử lý data nhân viên hoặc khách hàng Việt (Chính phủ Việt Nam, 2023).

Q: Có thể ký Data Processing Agreement (DPA) với Anthropic không?

Có, dành cho API và Enterprise customers. Liên hệ Anthropic qua [email protected]. DPA cần thiết nếu bạn cần comply GDPR/PDPD chính thức khi xử lý personal data qua Claude. Với Claude.ai (web app), hiện chưa có DPA option cho Free/Pro: đây là lý do không nên dùng Free/Pro cho sensitive data (Anthropic Trust Center, 2025).

Q: Dùng Claude API có an toàn hơn Claude.ai web app không?

Về data privacy: API an toàn hơn nhờ contractual no-training guarantee, không persistent storage, và có thể ký DPA. Theo IBM 2024, công ty dùng AI có data isolation giảm 28% chi phí breach so với công ty không có. Về security (account compromise, MITM): tương đương. API cho phép kiểm soát hoàn toàn system prompt, không gửi conversation history, và log mọi requests phía bạn (IBM, 2024).

Q: Làm sao để xóa data đã gửi cho Anthropic?

Với Claude.ai: Settings, Clear conversation history (xóa phía bạn). Để yêu cầu Anthropic xóa data: gửi email [email protected] với subject "Data Deletion Request". Theo policy họ xử lý trong 30 ngày, tương đương timeline của GDPR Right to Erasure. Lưu ý: data đã được dùng trong một request hoàn chỉnh thì không thể "thu hồi". Tốt hơn là không gửi sensitive data ngay từ đầu.

Q: Startup nhỏ có cần quan tâm đến compliance này không?

Có, ngay từ đầu. PDPD áp dụng với mọi tổ chức xử lý dữ liệu cá nhân tại Việt Nam, không phân biệt quy mô. Theo Dự thảo Luật Bảo vệ Dữ liệu Cá nhân 2025, vi phạm có thể bị phạt đến 5% doanh thu toàn cầu, tương tự GDPR. Với startup, xây dựng habit dùng AI đúng cách từ đầu dễ hơn nhiều so với retrofit compliance sau khi có 50+ nhân viên đang dùng tự do.